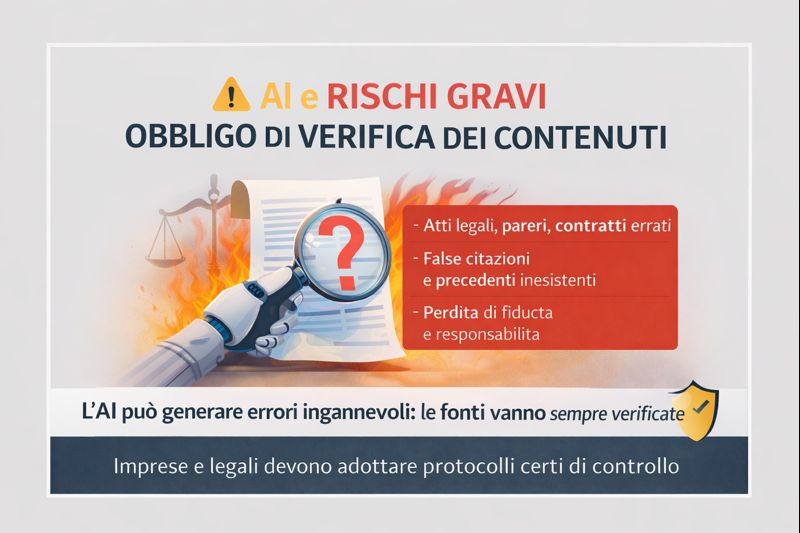

C’è un punto che oggi non può più essere archiviato come un semplice incidente tecnologico: l’intelligenza artificiale può produrre contenuti formalmente corretti ma giuridicamente falsi — citazioni, precedenti, riferimenti normativi — con un livello di verosimiglianza tale da superare una lettura non critica.

È il segnale, ormai evidente, che emerge anche da recenti vicende di cronaca giudiziaria, nelle quali l’utilizzo non presidiato di strumenti di AI ha condotto all’inserimento di richiami giurisprudenziali inesistenti, imponendo successive verifiche e accertamenti.

Il problema, dunque, non è l’AI in sé: il problema è l’illusione di poter delegare alla tecnologia la verifica della correttezza giuridica.

L’errore “credibile” è il più pericoloso: quando l’AI “allucina”, non mente: costruisce una risposta plausibile.

Ma in ambito giuridico e aziendale il risultato non cambia: un errore che sembra vero entra nei documenti, orienta decisioni, condiziona strategie, altera il contraddittorio ed espone a responsabilità.

È qui che il rischio diventa sistemico.

Per le imprese, l’impatto va ben oltre il processo. L’uso improprio dell’AI può incidere su:

Un riferimento sbagliato può tradursi in contenzioso, sanzioni, danni reputazionali e perdita di fiducia da parte di stakeholder, partner e autorità.

Un protocollo “anti-allucinazioni” è oggi indispensabile!!!!

L’esperienza operativa suggerisce alcune regole minime non più rinviabili:

TECNOLOGIA SI, MA SOLO SE GOVERNATA

Il messaggio è ormai inequivoco: la diligenza non diminuisce con l’AI, aumenta.

Chi utilizza strumenti di intelligenza artificiale senza presidi organizzativi e giuridici adeguati non sta innovando: sta semplicemente accumulando rischio.

È per questo che le imprese non possono affidarsi a soluzioni improvvisate o all’uso individuale degli strumenti. Serve un approccio strutturato, integrato e preventivo.

👉 Rivolgersi a Tutela d’Impresa significa dotarsi di un modello di accompagnamento legale e strategico che consenta di:

In un contesto in cui l’errore “credibile” è il più insidioso, la vera tutela non è correre dietro ai problemi, ma impedirne la nascita.

CONTATTI

info@tuteladimpresa.it

tuteladimpresa@legalmail.it

Tel. 06 963 1888

SEDE

Piazza Cairoli, 26

Velletri 00049

(RM) - Italia

partita iva 18394201000

nr. rea 1781818